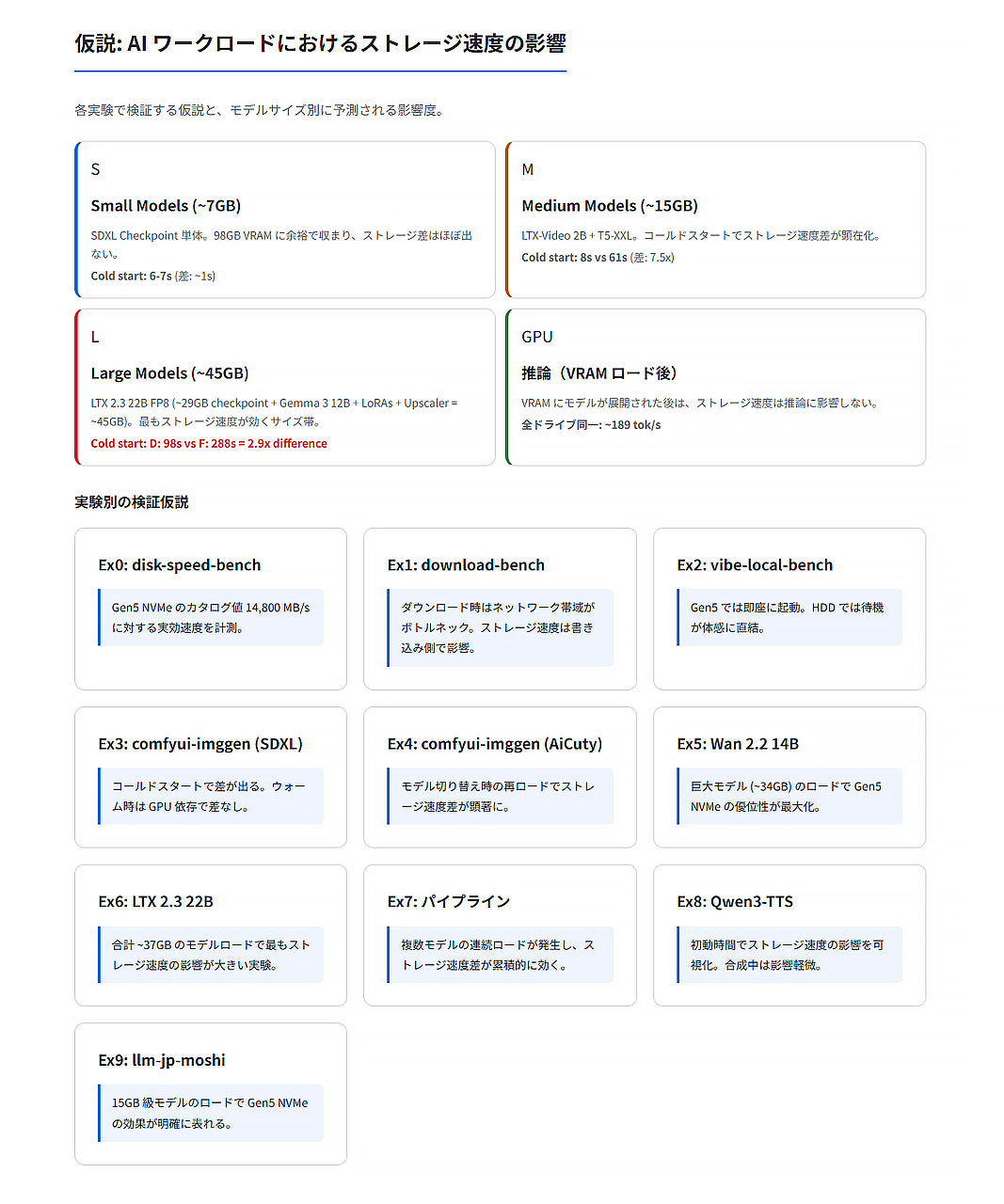

トピック

高速なSSDを使うとAI処理も速くなる?AIクリエイターにガチ検証してもらった

最速ストレージはDドライブに!AI処理を快適にするならPCIe 5.0 SSDだ text by 日沼諭史

- 提供:

- Samsung 機材協力:株式会社アスク

2026年4月20日 00:00

「生成AI」は、とにかく高性能なGPUに大容量のVRAMが“命”とされている。しかし、実際に使ってみるとほかの部分の性能もパフォーマンスに影響するのではないだろうか。HDDやSSDも品不足となっているので、なんとなくAI処理の性能に影響しそうなイメージはあるが……。

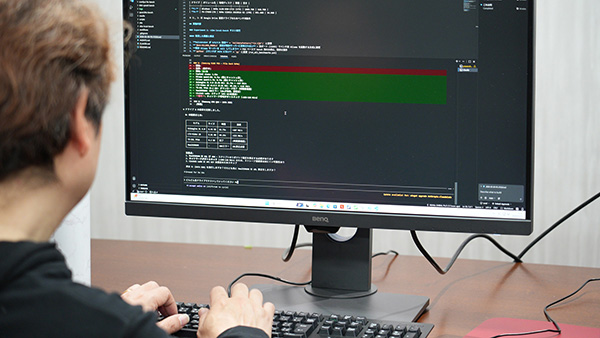

そんな疑問に答えを出すべく、生成AI関連の著書も多数執筆しているクリエイターの白井暁彦氏にガチ検証を依頼。今回のために開発したベンチマークツールを用いて、ストレージがAI処理に与える影響を定量分析し、「ストレージが速ければAI処理も速くなるのか」を確かめてもらった。

ローカルのAI処理でストレージ速度は重要なのかクリエイターに検証してもらった

生成AIは大きく分けると、サーバーで処理を行うクラウド型のAIと手元のPCで処理を行うローカルAIに分けられる。ChatGPTやClaudeなどのクラウド型のAIは導入のしやすさという点でメリットがあり、ローカルAIは自分のPC内で処理が完結するためサービス利用料が不要で、秘匿性の高い情報を扱うのに適しているといったメリットがある。今回はローカルAIの方に注目してみていきたい。

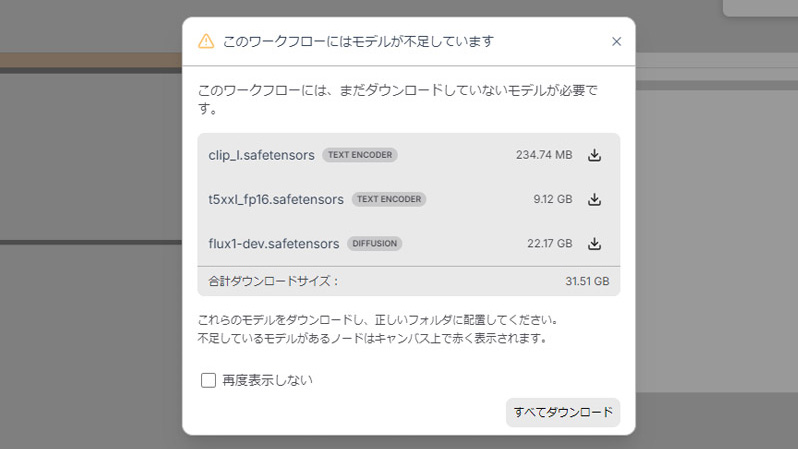

AIの高速処理においては、GPU性能の高さが鍵を握っているのはみなさんご存じの通り。しかし、ストレージの性能に関しては最初は見落としがちではないだろうか。ローカルでAI処理を行うには、AIのモデルデータをローカルのストレージに用意しておく必要がある。基本的には「賢い」AIモデルほどデータが大きくなり、1つあたりのサイズは数十GBに及ぶことも珍しくない。

用途に応じてAIモデルの切り替えを頻繁に行うとすれば、必要なモデルデータ全てをあらかじめストレージに置いておくことになるため、あっという間に数百GB、数TBが埋まってしまう。

メモリとともにストレージも大幅に値上がりしているなか、これはなかなかにやっかいな問題だ。割高なNVMe SSDをデータ置き場にするのを避け、比較的低コストで導入できるSATA SSDやHDDに保存している、という人もいるのではないだろうか。

とはいえ、生成AIを活用して生産性を高めるには少しでも高速化を図りたいところ。もしストレージを高速なSSDにすることでパフォーマンスアップできるのであれば、ぜひともそうしたいと考える人も少なくないはずだ。逆に低コストなHDDなどでも十分なAI性能を確保できるのであれば、とにかく容量重視のマシン構成で突き進むという考え方もアリということになる。

そんなわけで、ストレージの違いでAI処理が高速になるのか、逆にストレージ性能はあまり影響しないのか、実際のところはどうなのか調査するべく、クリエイターであり生成AI分野にも詳しい白井氏に相談した。

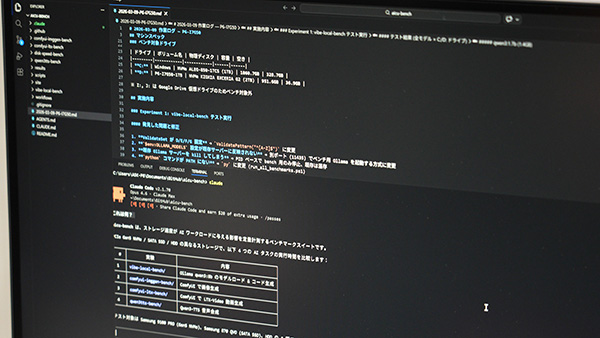

同氏によると、ストレージの種別ごとにAI性能を計測する手軽なベンチマークテストは見つけることができなかったとのこと。そのため、定量分析を可能にする検証ツールを白井氏自ら開発。それを用いていくつかのAIワークロードにおける実速度を計測し、SSDやHDDなど異なるストレージでAI処理の速度の違いをチェックすることとなった。

NVMe SSD・SATA SSD・SATA HDDでAI処理の性能差を検証テスト用PCにRTX PRO 6000 + メモリ192GB搭載ハイエンドワークステーションを用意

検証ツールを独自に用意するといっても、1から手組みで本格的なベンチマークプログラムを作り上げるのはあまりにも時間がかかりすぎる。そこで白井氏はAIコーディングをフル活用し、生成AIツールをコントロールしてストレージごとの処理速度の違いを計測するプログラムを作り上げた。ちなみに、「AICU-SSD-Bench」として公開されているので、テストしてみたいユーザーは試してみてもらいたい。

検証に用いるPCはLenovoのワークステーション「ThinkStation P8」を用意。CPUはAMD Ryzen Threadripper PRO 7975WX(32コア/64スレッド)、メインメモリは192GB、GPUはVRAM 96GBのNVIDIA RTX PRO 6000 Blackwell Max-Q Workstation Editionという、まさにモンスター級AIマシン。ストレージ以外の性能がボトルネックになることがないように、現在用意できる最高クラスの性能のモデルを手配した。

| Lenovo ThinkStation P8 | |

|---|---|

| CPU | AMD Ryzen Threadripper PRO 7975WX |

| GPU | NVIDIA RTX PRO 6000 Blackwell Max-Q Workstation Edition |

| メモリ | DDR5-4800 192GB(32GB×6) |

| OS起動ディスク | Samsung 9100 PRO SSD 2TB |

| OS | Windows 11 Pro |

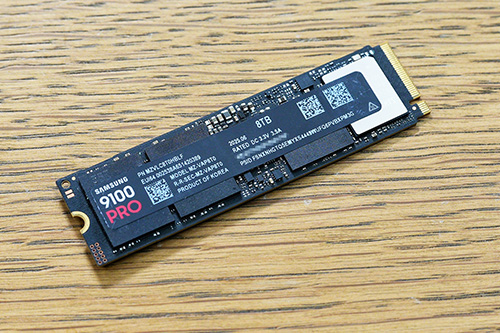

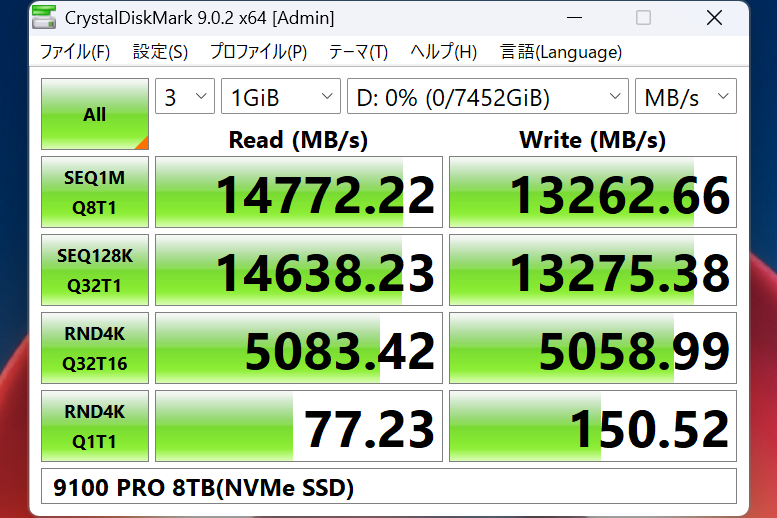

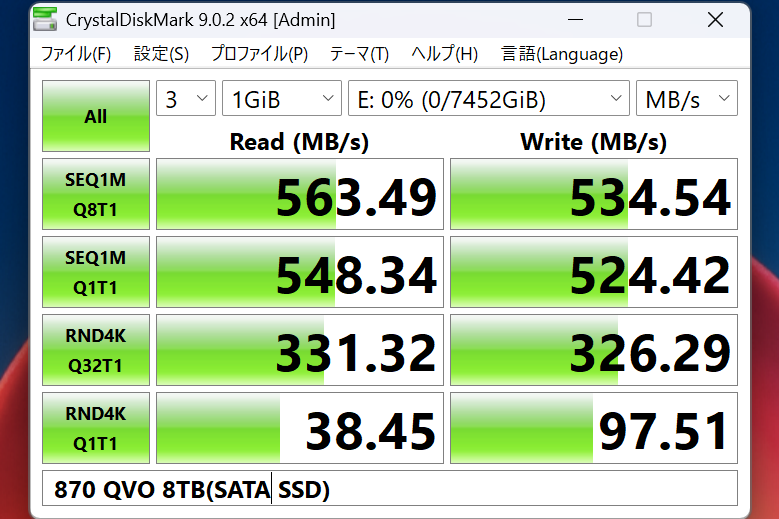

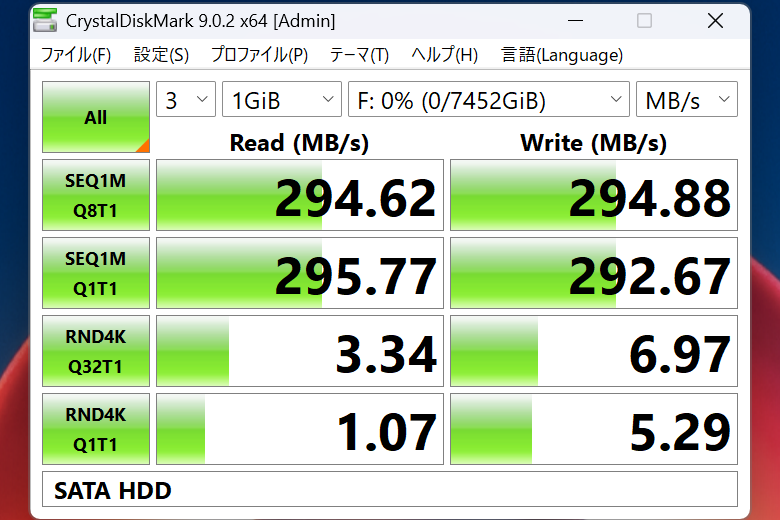

AI用途での性能比較にはSamsung 9100 PRO SSD 8TB(以下9100 PRO)、Samsung 870 QVO SSD 8TB(以下870 QVO)、3.5インチHDD 8TBを用意した。最速クラスのNVMe SSDに、標準的なSATA SSDとSATA HDDの3パターンで性能差が出るのかを見てみたい。

今回使用している9100 PROは、PCIe 5.0 x4接続で最大14,800MB/sとハイエンドクラスのSSD。これがAI用途でも高速という結果になれば、積極的に高速なストレージを選ぶ理由にもなるだろう。逆にSATA SSDやSATA HDDの転送速度でも性能が出るのであれば、コストパフォーマンス面で廉価SSDやHDDが有力な選択肢になる可能性もある。

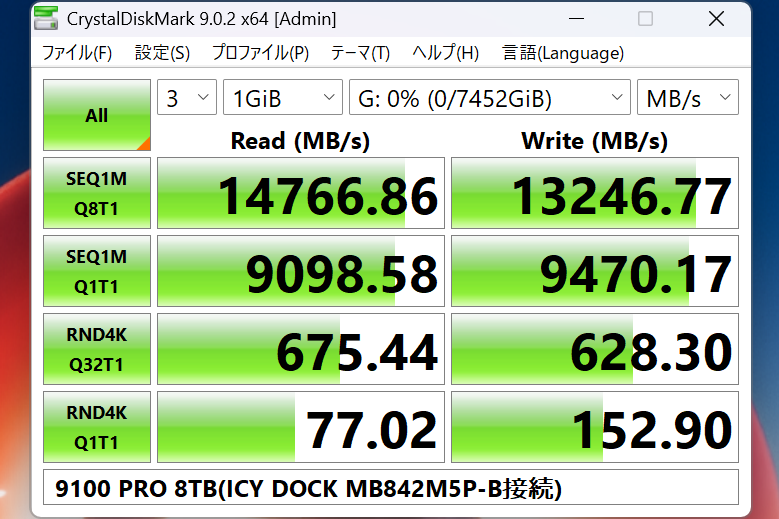

ストレージ性能の直接の比較とはまた別の話になるが、今回M.2 SSDをリムーバブル化するICY DOCK ExpressSlot Elite(MB842M5P-B)に9100 PRO(8TB)を搭載した環境もテストに加えた。

ExpressSlot Eliteのデータ転送レートは最大128Gbpsで、理論値はマザーボードのM.2スロットにSSDを接続した際と同じ速度が出ることになる。AI用途でM.2スロットに接続したSSDと同等のパフォーマンスが出るのであれば、プロジェクトごとにSSDを交換したり、使用するAIモデルの切り替えをSSD自体を入れ替えることで行えたりと、利便性を向上させることができる。

コード生成/画像生成/動画生成をメインにストレージのAI性能をテスト

今回行うストレージの性能テストについて紹介しよう。白井氏が開発した検証ツールは、主に下記の項目を全てのドライブにおいてテストし、処理の速度や時間などの違いからそれぞれのパフォーマンスを明らかにするというもの。

・コード生成(Qwen3 8B)

・ComfyUIによる画像生成(Stable Diffusion XL他)

・ComfyUIによる動画生成(複数AIモデル使用)

細かいテスト項目まで含めると数が多いので、今回は代表的な結果に絞って紹介するが、検証ツールは使用するPCのスペックから結果の予測が表示されるようになっており、実測値が予測通りになるのかを検証するかたちで進められた。

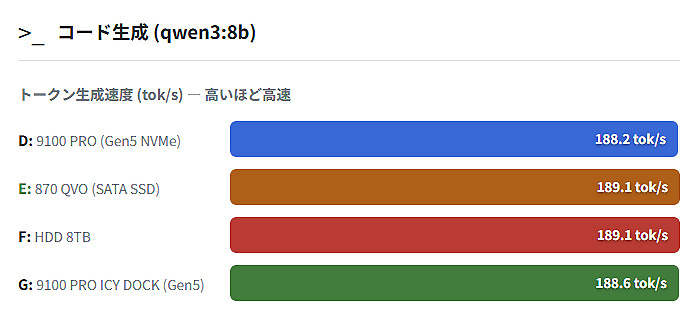

コード生成テスト

まず「コード生成」については、1秒間に生成する情報量を表す「トークン生成速度(tok/秒)」が指標の1つになる。

ストレージによる性能差はトークン生成速度に出てくるはずなのだが、今回の環境ではストレージによる性能差がほぼない結果になってしまった。これはコード生成のAIモデルデータがVRAM内で完結してしまう処理であるためとのこと。コード生成の途中段階でストレージにアクセスすることがほぼなく、ビデオカード側の性能が豪華すぎたための結果のようだ。

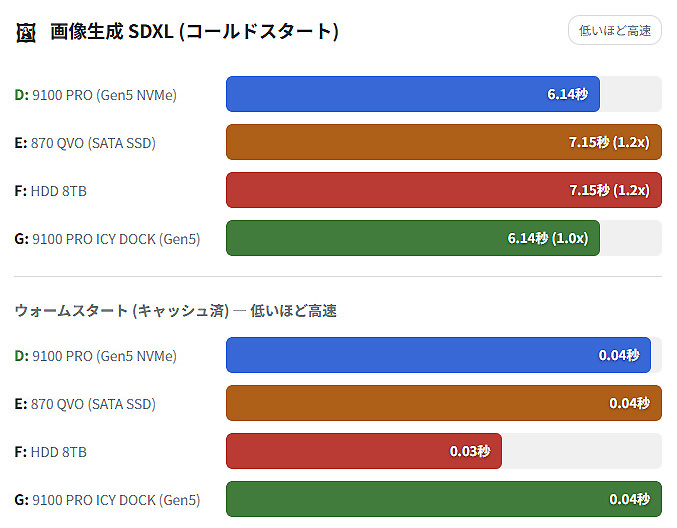

画像生成テスト

続いて「ComfyUI」による画像生成だが、こちらは明らかな差が見られる結果となった。いずれのドライブでも出力した画像の中身は完全に同一になるが、「コールドスタート」の状態、つまりAIモデルデータを読み込んだ後の初回の画像生成では、9100 PROがSATA SSD/HDDより2割以上高速だ。

なお、キャッシュを利用するウォームスタートになるとストレージ間の差がほぼない状態になるが、これはビデオカードのVRAM内にデータが収まってしまうためではないかとのことだった。VRAMからデータがあふれる場合はウォームスタートでもストレージの性能差が出てくるかもしれない。

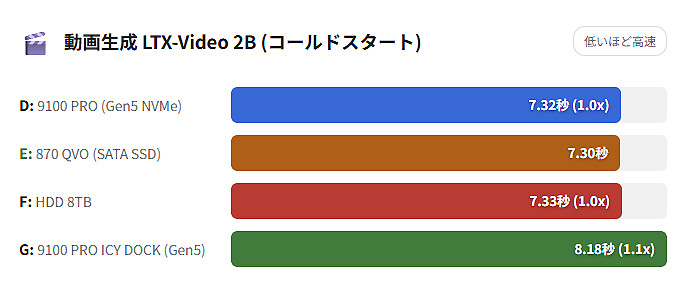

動画生成テスト

ComfyUIによる大容量のAIモデルデータを使用した動画生成では、データサイズが大きくなるにつれてより顕著な結果が出るようになった。

まずは小さめのAIモデルデータとなるデータサイズ15GBの「LTX 2B」で動画生成した際の結果から紹介するが、こちらはICY DOCK「ExpressSlot Elite接続の9100 PROが若干遅い結果となったが、ストレージ間で大きな差はなかった。

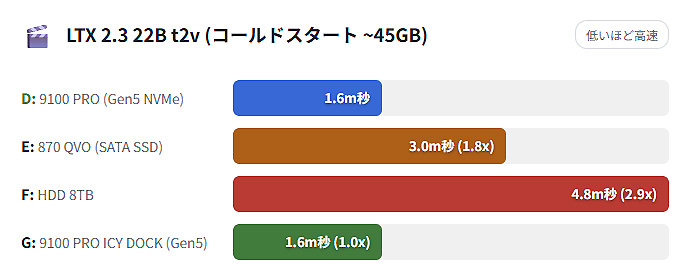

一方、データサイズ45GBのLTX 2.3 22BのAIモデルデータを使用した動画生成では、9100 PROがSATA SSDの870 QVOに対して約1.8倍、SATA HDDに対して約2.9倍も高速という結果になっている。

コールドスタートの高速さは、データの読み込みが増えるVRAM容量が少ない環境において価値が出てくる可能性が高い。VRAMが十分でないとAIモデルをその都度ロードして切り替えながら使うことになるので、コールドスタートと同じ状況になりがちだが、ストレージが高速ならその弱点をある程度カバーできるのではないだろうか。

今回のような96GBものVRAMを搭載するマシンなら、複数のモデルデータを同時にロードした状態にしておけるのでウォームスタートの機会が多く、コールドスタートが高速な利点は薄くなるかもしれない。しかしそうでない限りは、できるだけ高速なSSDで処理することが効率アップに結び付くと考えて良いだろう。

45GBのLTX 2.3 22Bを使い、コールドスタートとウォームスタートの連続実行による性能差なども見てもらったが、この際は9100 PROがコールドスタート時98.4秒に対しHDDはコールドスタート時288.1秒かかっていた。最大でも3分程度の差と小さく見えるかもしれないが、実際にAIを使い作品を作るときはこうしたロードを待つ時間は結構多くなるとのことで、1日の作業を合算するとロード時間は数時間に及ぶ場合もあるそうだ。大容量のAIモデルデータを使用する環境では、大きく待ち時間を削減できる可能性が高く、NVMe SSDを導入することが望ましいと言えるのではないだろうか。

なお、ICY DOCK ExpressSlot Elite(MB842MP-B)については、オンボードの9100 PROとおおむね同等のパフォーマンスを発揮しており、接続方法は異なっていても高速なNVMe SSDの実力をしっかり引き出せることが分かった。安心して大容量SSDストレージ環境を構築し、ローカルAIをガンガン動かせそうだ。

AI処理を快適にするなら高速ストレージはアリ!「一番いいSSD」はCドライブではなくDドライブ以降に

今回のベンチマークテストにより、AIモデルデータを9100 PROのような高速なSSDに保存することで、確かなパフォーマンス向上につなげられることが分かった。

連続で1時間程度AI処理を続けていてもサーマルスロットリングなどによるパフォーマンス低下は見られず、「AIクリエイターにとって、9100 PROは“待たないAI環境”を実現する最適なストレージであることは間違いない」と白井氏は結論づける。

今回のテストの結果を受け「データをストレージへ置くときの考え方が変わってくるかもしれない」とも同氏。個人ユーザーはもちろん映像スタジオやゲーム会社など、生成AIを補助的にでも活用しているところでは、より高速なストレージにAIモデルデータを配置することで効率アップする可能性があると語る。

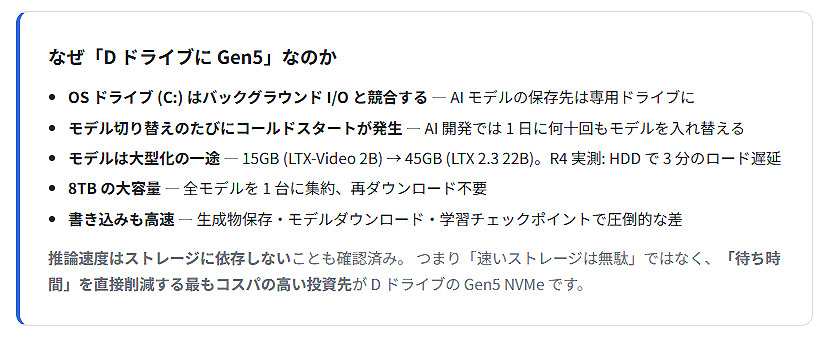

ただしこのときに気を付けておきたいのは、「システムドライブをデータ置き場にしないこと」だという。なぜなら、OSがインストールされているシステムドライブは常時OSやアプリケーションなどからの読み書きが発生しているためだ。それがAIツールの動作やモデルデータの読み込みなどに影響を与える可能性はゼロではない。

PCやストレージを新調するときには、なんとなくシステムドライブに「一番いい」SSDを使いたくなるところ。しかし、実際にはDドライブ以降(非システムドライブ)を高性能なSSDにしてモデルデータ置き場にするのがベスト。優先度を考えると、システムドライブは「そこそこの性能」のSSDで十分と言える。

ストレージが高騰している昨今の市場環境を鑑みても、抑えるべきところは抑え、実効性のあるところにはしっかり投資していくことが大事。メリハリをつけた構成でコストパフォーマンスを最大化し、快適なローカルAIマシンをみなさんも作り上げてほしい。